martes, 03 octubre 2023 | Redes

Cómo Google fue incorporando Inteligencia Artificial a lo largo de 25 años

El gigante de google fue uno de los primeros en utilizar la llamada “Inteligencia Artificial” con el simple corrector ortográfico, luego incorporó el traductor, hasta llegar a añadir la IA generativa. Un repaso de los mayores momentos de IA hasta ahora.

Desde el año 2001 Google comenzó a incorporar inteligencia artificial en su buscador con la corrección ortográfica, luego fue incorporando más funciones que facilitan las búsquedas y la utilización del servicio.

Año 2001: CORRECCIÓN DE ORTOGRAFÍA

El aprendizaje automático ayuda a los usuarios de la Búsqueda de Google a corregir su ortografía. Fue una de las primeras opciones de inteligencia artificial en e buscador.

El cofundador de Google, Larry Page, alguna vez dijo: "El motor de búsqueda perfecto debe entender exactamente lo que quieres decir y entregarte exactamente lo que necesitas".

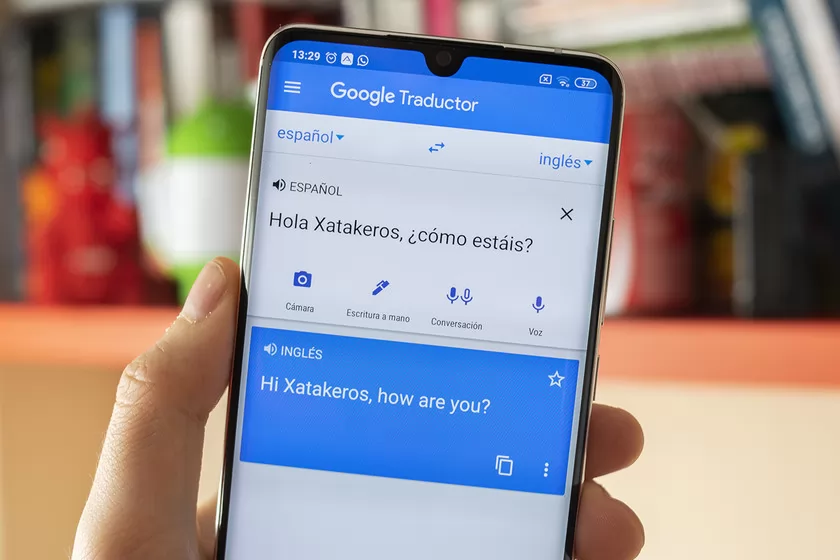

Año 2006: GOOGLE TRANSLATE

Cinco años después, se lanzó Google Translate, que usa el aprendizaje automático para traducir idiomas automáticamente. Hoy Google Translate admite 133 idiomas hablados por millones de personas alrededor del mundo. Esta tecnología puede traducir texto, imágenes o incluso una conversación en tiempo real, rompiendo las barreras del idioma en toda la comunidad global, ayudando a las personas a comunicarse y ampliando el acceso a la información como nunca antes.

Año 2015: TENSORFLOW

La introducción de TensorFlow, un nuevo marco de aprendizaje automático de código abierto, hizo que la IA fuera más accesible, escalable y eficiente. También ayudó a acelerar el ritmo de la investigación y el desarrollo de la IA alrededor del mundo. TensorFlow es ahora uno de los marcos de aprendizaje automático más populares y se ha utilizado para desarrollar una amplia gama de aplicaciones de IA, desde el reconocimiento de imágenes hasta el procesamiento del lenguaje natural y la traducción automática.

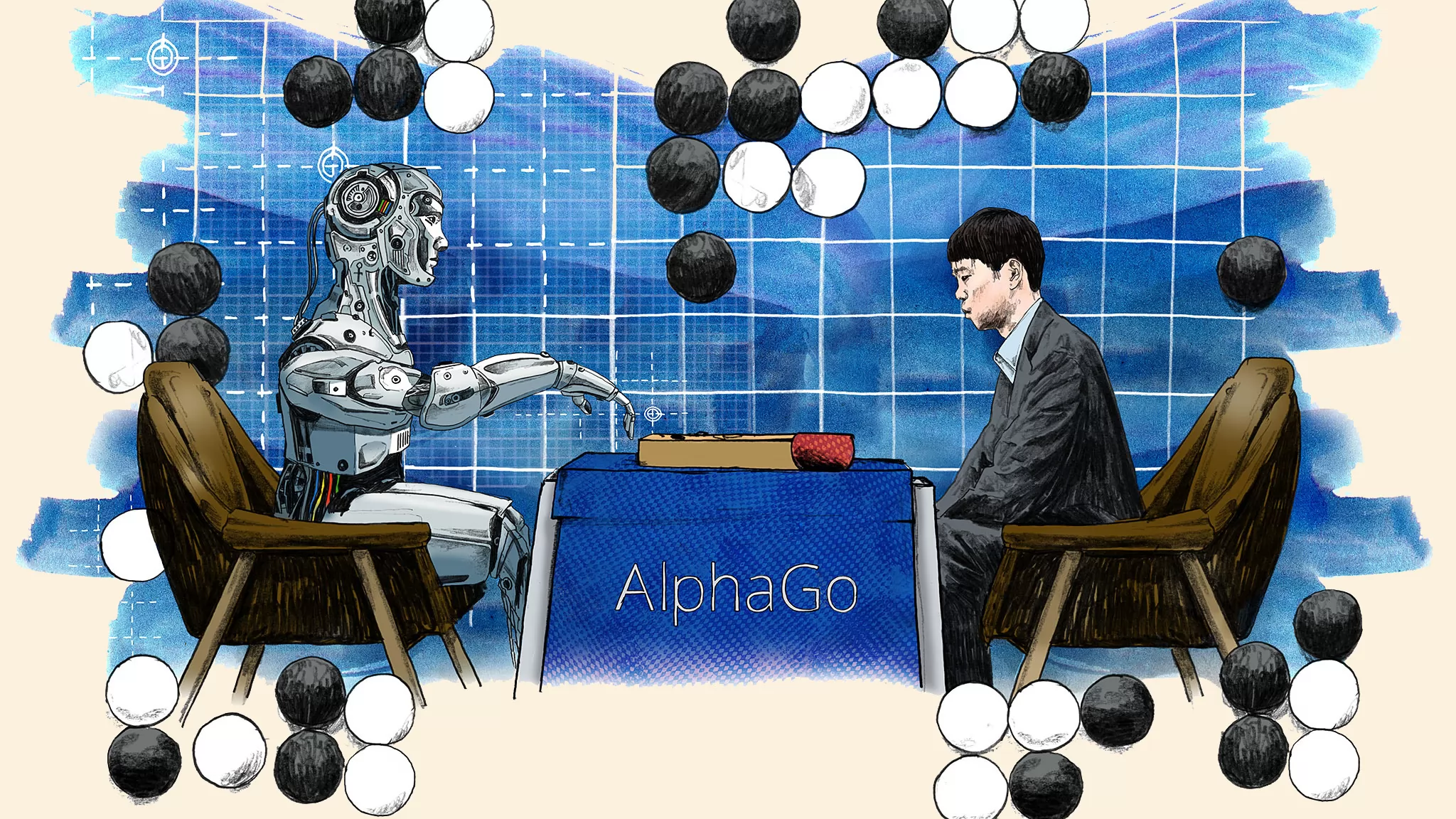

Año 2016: ALPHAGO

Más de 200 millones de personas vieron en línea cómo AlphaGo se convirtió en el primer programa de IA en derrotar a un campeón mundial humano en Go, un complejo juego de mesa que antes se consideraba fuera del alcance de las máquinas.

Esta victoria histórica demostró el potencial del aprendizaje profundo para resolver problemas complejos que antes se consideraban imposibles para las computadoras.

Año 2016: TPU

Las unidades de procesamiento tensorial, o TPU, son chips de silicio diseñados a la medida que inventamos específicamente para el aprendizaje automático y optimizados para TensorFlow.

Pueden entrenar y ejecutar modelos de IA mucho más rápido que los chips tradicionales, lo que los hace ideales para aplicaciones de IA a gran escala.

Año 2017: GOOGLE RESEARCH PRESENTA TRANSFORMER

El artículo de investigación de Google Research "Attention Is All You Need" presentó el Transformer, una nueva arquitectura de red neuronal que ayudó a la comprensión del lenguaje.

Antes de Transformer, las máquinas no eran muy buenas para entender el significado de oraciones largas: no podían ver las relaciones entre palabras que estaban muy separadas.

Transformer ha revolucionado lo que significa para las máquinas traducir, resumir textos, responder preguntas e incluso generar imágenes y la robótica.

Año 2019: BERT

Se trata de una solución que incorpora nuevos algoritmos basados en inteligencia artificial. La introducción del "Bidirectional Encoder Representations from Transformers" (Representaciones bidireccionales de codificadores a partir de Transformers), o BERT para abreviar, ayudó a la Búsqueda a comprender las consultas de los usuarios mejor que nunca.

En lugar de tratar de entender las palabras individualmente, nuestros algoritmos BERT ayudaron a Google a entender las palabras en contexto. Esto condujo a una gran mejora de la calidad en la Búsqueda.

Año 2020: ALPHAFOLD

AlphaFold, que fue reconocido como una solución al "problema del plegamiento de proteínas". Las proteínas son los componentes básicos de la vida, y la forma en que una proteína se pliega determina su función; una proteína mal plegada podría causar enfermedades. Durante 50 años, los científicos habían estado tratando de predecir cómo se plegaría una proteína para ayudar a comprender y tratar enfermedades.

AlphaFold hizo exactamente eso. Luego, en 2022, compartimos 200 millones de estructuras de proteínas de AlphaFold, que cubren casi todos los organismos del planeta de los que se ha secuenciado su genoma, libremente con la comunidad científica a través de la base de datos de estructuras de proteínas de AlphaFold. Más de 1 millón de investigadores ya lo han utilizado para trabajar en una diversidad de cosas, desde acelerar nuevas vacunas contra la malaria en un tiempo récord y avanzar en el descubrimiento de fármacos contra el cáncer, hasta desarrollar enzimas que se alimentan de plástico.

Año 2023: BARD

Lanzado en marzo, Bard ahora está disponible en la mayor parte del mundo y en más de 40 idiomas, por lo que más personas que nunca pueden usarlo para aumentar la productividad, acelerar las ideas y alimentar la curiosidad. Y hemos combinado el modelo más inteligente y capaz de Bard con los servicios de Google que usas todos los días, como Gmail, Docs, Drive, Vuelos/Hoteles, Maps y YouTube, para que te sea aún más útil con tareas como la planificación de viajes, la verificación de respuestas y el resumen de correos electrónicos o documentos.

Realizaron un importante operativo para retirar la ballena que apareció muerta en el Río de la Plata

Convocan a una marcha en pedido de justicia por el crimen de Mateo Arévalo en Capitán Bermúdez

Vialidad Nacional: Graciela Aleñá presentó una acción judicial para reclamar la inconstitucionalidad del Decreto 461/25

San Lorenzo: Alonso salió bien de su cirugía y esperan su evolución las próximas 48hs

La salud de la"Locomotora" Oliveras evoluciona favorablemente tras sufrir un ACV

Es de Santa Cruz y fue detenido en San Lorenzo por robar en una obra en construcción

Pidió un Uber a San Lorenzo e intentaron llevarla por la fuerza a Roldan: dos detenidos

Liga Sanlorencina: el fútbol femenino ya tiene fecha para completar la jornada postergada